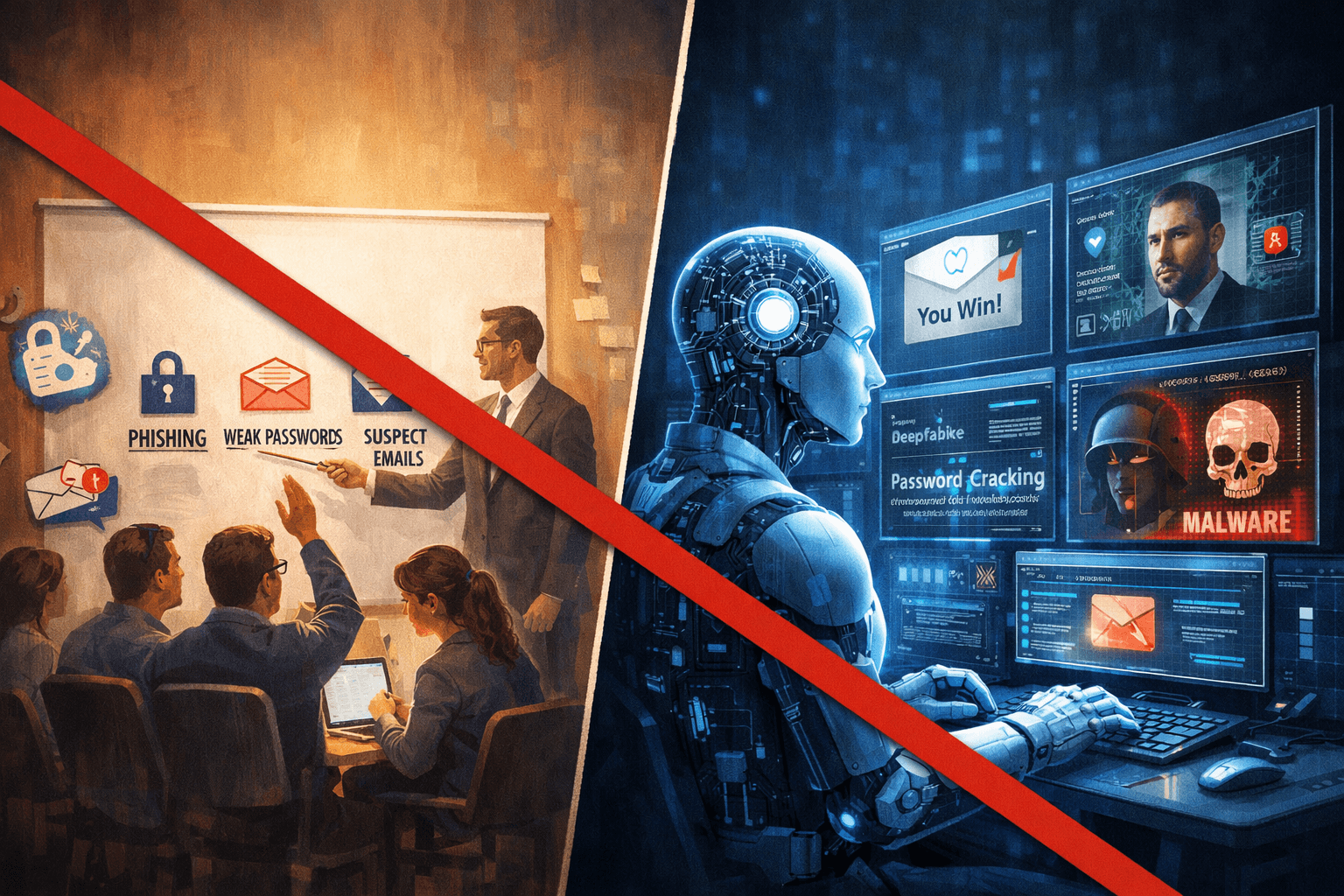

Isso mesmo, apenas treinamentos em conscientização de segurança não são suficientes. Eles devem continuar sendo parte essencial da estratégia, mas precisam ser complementados com tecnologia e processos mais robustos. Trago neste artigo pontos de atenção sobre deepfakes e um cofo maior no phishing hiperpersonalizado.

Estava lendo um artigo na FORTUNE (Boards aren’t ready for the AI age: What happens when your CEO gets deepfaked?) e algo me chamou a atenção. Como vamos nos proteger dos deepfakes? Aquele phishing que conhecemos, aquele e-mail suspeito que não podemos clicar, que pode causar roubo de informações, baixar vírus, comprometer dados corporativos, está desaparecendo. Não porque as ameaças diminuíram, mas porque evoluíram para algo muito pior: e-mails quase impossíveis de detectar que não são verdadeiros!

Em 2025, criminosos clonaram a voz do Ministro da Defesa da Itália e ligaram para a elite empresarial. Uma vítima transferiu quase €1 milhão antes de descobrir o golpe. Meses antes, uma empresa de publicidade global quase caiu em uma armadilha quando criminosos criaram uma conta falsa do CEO no WhatsApp e encenaram uma chamada do Microsoft Teams com uma voz clonada treinada em vídeos do YouTube. Esses não são incidentes isolados, eles representam uma tendência que explodiu em 2025: deepfake fraud drenou US$ 1,1 bilhão de contas corporativas americanas, triplicando em relação a 2024.

Esses casos representam apenas a ponta do iceberg. O phishing hiperpersonalizado potencializado por inteligência artificial está se tornando a ameaça corporativa mais sofisticada. 85% das organizações experimentaram pelo menos um ataque de deepfake em 2025. Os dias dos e-mails genéricos com erros de gramática acabaram. A nova geração de ataques é tão sofisticada que está tornando o treinamento de funcionários (a principal defesa das empresas) obsoleto.

Realidade de Custos:

| Tipo de campanha | Custo | Nível de personalização | Velocidade |

| Human Spear Phishing | $50-200/hora | 10-50 alvos | 1-2 emails/hora |

| AI Mass Personalization | Próximo a zero | 10,000+ alvos | 100+ emails/hora |

Como funciona o ataque?

Um bot de IA seleciona uma empresa-alvo e varre a internet. Encontra no LinkedIn a estrutura organizacional, funcionários e projetos. Depois, cruza informações de múltiplas redes sociais, por exemplo: Descobrir que um gerente financeiro viajou para a Itália, que torce para o Flamengo, que um analista participou de uma conferência específica.

Com esse dossiê digital, a IA cria a isca automaticamente. O gerente não recebe um e-mail genérico, mas uma mensagem que menciona a viagem, o time, e pede aprovação de uma fatura de um fornecedor real. Gramaticalmente perfeita. Contexto impecável.

Os números confirmam a eficácia devastadora: e-mails de phishing com IA alcançam 54% de taxa de cliques, contra apenas 12% dos e-mails de controle. Desde 2023, ataques de phishing com IA aumentaram 1.265%. Em 2025, ataques de phishing com IA cresceram 5x, sendo 14x mais frequentes em campanhas de dezembro de 2025, e 75% mais efetivos em contornar filtros de e-mail tradicionais.

Por que o treinamento não funciona mais?

Historicamente, as pessoas eram ensinadas a identificar phishing por erros de ortografia, gramática ruim ou contexto inconsistente. Mas a IA generativa eliminou todos esses sinais. Ela gera e-mails gramaticalmente perfeitos, imita estilos de comunicação autênticos e personaliza profundamente cada ataque.

Pesquisadores da IBM demonstraram que a IA constrói uma campanha de phishing sofisticada em 5 minutos, o que demoraria em média 16 horas para especialistas humanos em segurança. Exigir que um funcionário, no meio de um dia agitado, identifique uma isca tão bem elaborada é uma aposta perdida!

O desafio mais significativo é que a IA produz conteúdo altamente sofisticado, contextualmente preciso e personalizado que efetivamente imita comunicações legítimas. Essa capacidade mina diretamente os métodos tradicionais usados pelos sistemas de segurança de e-mail para identificar ameaças.

Se o fator humano é o elo mais fraco, a solução deve ser fortalecer as defesas tecnológicas. As abordagens tradicionais, baseadas em assinaturas e filtros de palavras-chave, são ineficazes contra ataques “polimórficos”, onde cada e-mail é único!

Dicas Práticas para Se Proteger

Se a defesa puramente humana não funciona mais, o que fazer? Aqui estão dicas práticas para profissionais em contextos corporativos e pessoais:

No Contexto Profissional:

1.Verifique por canal alternativo: Se receber um e-mail ou chamada de seu chefe ou colega pedindo uma ação urgente (transferência de dinheiro, dados sensíveis), não responda pelo mesmo canal. Ligue ou envie mensagem por outro meio para confirmar a autenticidade.

2.Desconfie de urgência: Ataques de phishing com IA criam pressão temporal. “Preciso disso agora”, “Isso é confidencial”, “Não mencione para ninguém”. Essas são bandeiras vermelhas.

3.Estabeleça palavras-chave de segurança: Com seus colegas e chefes, defina uma palavra ou frase que será sempre usada em comunicações sensíveis. Se não estiver lá, é suspeito.

4.Não confie apenas em voz ou vídeo: Deepfakes de voz e vídeo são cada vez mais realistas. Se alguém o chama para autorizar uma transação financeira, insista em confirmar pessoalmente ou por vídeo chamada com verificação de identidade adicional.

No Contexto Pessoal:

1.Limpe suas redes sociais: Quanto menos informação pessoal disponível publicamente (viagens, hobbies, relacionamentos), mais difícil é para criminosos personalizar ataques.

2.Desconfie de reconexões inesperadas: Se alguém que não fala com você há anos de repente entra em contato com informações muito pessoais, pode ser um ataque.

3.Nunca clique em links de e-mails não solicitados: Mesmo que pareçam vir de amigos ou família. Acesse o site diretamente pelo navegador.

4.Use autenticação de dois fatores: Em contas bancárias, e-mail e redes sociais. Isso adiciona uma camada de proteção mesmo se suas credenciais forem comprometidas.

Conclusão

A era do phishing amador acabou. A IA colocou nas mãos de qualquer criminoso a capacidade de criar ataques personalizados em escala industrial. Continuar depositando a responsabilidade principalmente na vigilância dos funcionários é uma estratégia de segurança falha.

As organizações precisam aceitar a nova realidade: a guerra contra o phishing agora é uma batalha de algoritmos. Investir em defesas de e-mail baseadas em IA que detectem anomalias comportamentais e contextuais não é mais um luxo, é uma necessidade crítica para a sobrevivência!

O predador digital evoluiu. Sua armadura também precisa evoluir.

Descomplicando a Cibersegurança

Quer saber mais sobre Cibersegurança de uma forma simples e direta, construindo uma base de conhecimento que suporte os desafios da IA?

Conheça meu livro: “Descomplicando a Cibersegurança” e tenha acesso a um conteúdo essencial para gestores e profissionais que precisam de clareza para navegar no cenário de riscos digitais.

Link para Amazon: https://a.co/d/00y4w0we

Referências

[1] “Boards aren’t ready for the AI age: What happens when your CEO gets deepfaked?”

[2] “AI-Generated Phishing vs Human Attacks: 2025 Risk Analysis”

https://www.brside.com/blog/ai-generated-phishing-vs-human-attacks-2025-risk-analysis