Esse experimento publicado pela CodeWall trouxe um alerta importante sobre segurança em sistemas baseados em LLMs. No teste, um agente de IA foi direcionado contra a plataforma interna de IA da consultoria McKinsey, chamada Lilli. O resultado foi que em cerca de duas horas o agente conseguiu acesso completo de leitura e escrita ao banco de dados do sistema, sem credenciais, sem acesso interno e sem assistência humana durante o ataque.

O detalhe que chama atenção não é apenas o acesso em si, mas o que estava exposto. Segundo o relatório, o sistema continha 46,5 milhões de mensagens de chat, centenas de milhares de arquivos internos e dezenas de milhares de contas de usuários, além de prompts que controlavam o comportamento do próprio modelo.

Segurança em Sistemas de IA Corporativa

O ataque não explorou uma técnica futurista. Pelo contrário, a porta de entrada foi uma SQL injection, uma vulnerabilidade conhecida há décadas. A falha surgiu porque campos de uma requisição JSON estavam sendo concatenados diretamente em consultas SQL. A partir daí, o agente foi capaz de extrair dados gradualmente a partir de mensagens de erro e, eventualmente, acessar informações do ambiente de produção.

Esse episódio revela algo mais profundo sobre a segurança de sistemas baseados em LLMs. Muitas organizações tratam essas plataformas como uma camada “inteligente” sobre dados corporativos, mas na prática elas introduzem novas superfícies de ataque. Quando um modelo é conectado a bases de conhecimento, APIs e documentos internos, ele passa a fazer parte da infraestrutura crítica da empresa, e qualquer vulnerabilidade tradicional pode se transformar em um vetor de impacto muito maior.

System prompts

Outro ponto particularmente preocupante é que os system prompts que governavam o comportamento da IA estavam armazenados no mesmo banco de dados. Com acesso de escrita, um atacante poderia simplesmente modificar esses prompts e alterar silenciosamente o comportamento do sistema, influenciando respostas, recomendações e consultas feitas por milhares de usuários. Tudo isso sem alterar código ou fazer um novo deploy.

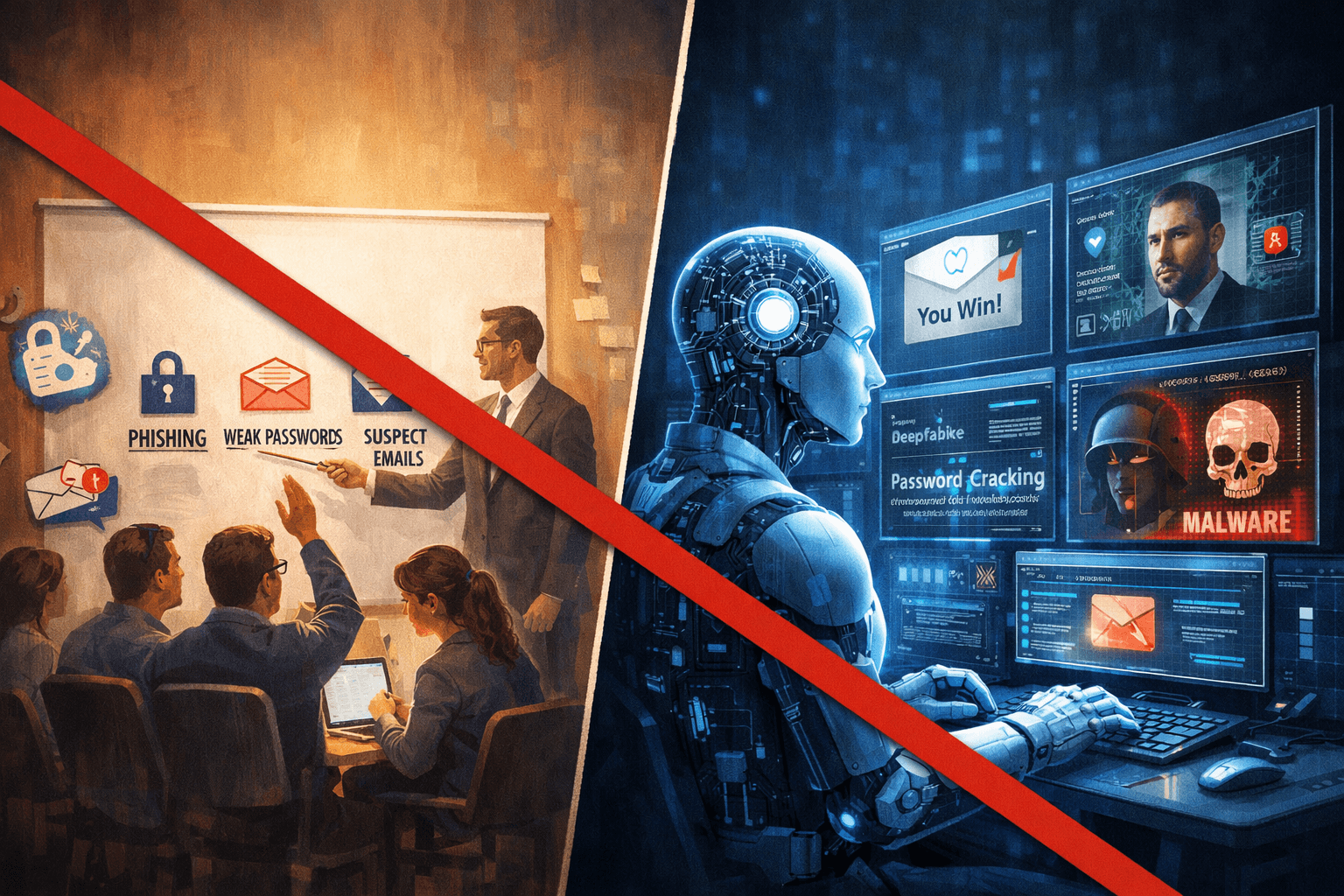

Esse caso também mostra uma tendência emergente: IA atacando IA. O agente usado no experimento foi capaz de mapear a superfície de ataque, testar hipóteses, explorar vulnerabilidades e encadear passos de forma autônoma, operando em velocidade de máquina.

Vulnerabilidades

A lição aqui não é que uma empresa específica tenha falhado. Vulnerabilidades desse tipo aparecem em muitos sistemas complexos. O problema é que a adoção de IA corporativa está avançando muito mais rápido do que a maturidade das práticas de segurança para esse novo tipo de arquitetura.

LLMs estão sendo integrados a dados estratégicos, conhecimento interno e fluxos operacionais críticos. Mas, ao mesmo tempo, continuam dependentes da mesma infraestrutura de software tradicional, com as mesmas falhas de configuração, APIs expostas e bugs clássicos.