A adoção da inteligência artificial generativa vem crescendo dentro das organizações. Mas, com ela, cresce também a necessidade de criar mecanismos que garantam segurança, conformidade, desempenho e responsabilidade. Em outras palavras, não basta adotar, é preciso monitorar. E monitorar bem.

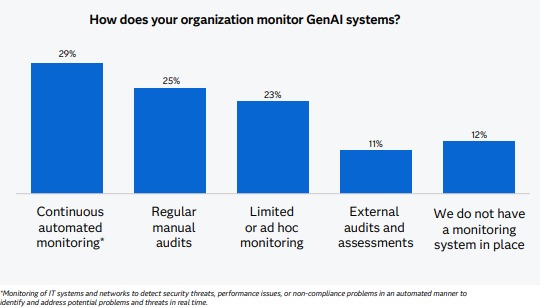

O gráfico do relatório da SAS mostra como as organizações estão se posicionando nesse aspecto. As respostas revelam um cenário de maturidade dividida, em que poucas empresas adotaram práticas avançadas de supervisão e muitas ainda operam sem qualquer estrutura formal para monitorar seus sistemas de GenAI.

Monitoramento contínuo ainda é minoria, mas é onde todos deveriam chegar

Apenas 29% das organizações adotam monitoramento automatizado contínuo para seus sistemas de GenAI. Isso significa que, em menos de um terço dos casos, a empresa consegue detectar problemas de segurança, falhas de desempenho ou violações de política em tempo real.

Esse modelo de monitoramento é o mais eficiente porque atua de forma proativa, detectando desvios antes que eles gerem impacto. Mas exige investimento em ferramentas, integração com o ambiente de TI e, principalmente, um time capacitado para interpretar e agir com base nos alertas.

Auditorias manuais são comuns, mas podem não acompanhar a velocidade da IA

Cerca de 25% das empresas ainda dependem de auditorias manuais regulares como principal forma de supervisionar seus sistemas de GenAI. Esse modelo, embora mais tradicional, pode ser insuficiente diante da natureza dinâmica e contínua da IA generativa, especialmente em aplicações que interagem com clientes ou que geram conteúdo em tempo real.

Auditorias são importantes, mas precisam ser complementadas com monitoramento automatizado, especialmente quando a GenAI atua em ambientes sensíveis ou com dados estratégicos.

Uma parcela significativa atua de forma improvisada ou limitada

Outros 23% operam com monitoramento ad hoc ou limitado, sem um plano definido. Isso significa que a detecção de falhas, violações ou anomalias depende de eventos pontuais, relatos manuais ou descobertas reativas.

Esse tipo de abordagem gera alto risco operacional e jurídico. A IA pode continuar operando fora do esperado por dias, semanas ou até meses, sem que ninguém perceba. Isso é especialmente preocupante em setores regulados, como saúde, finanças ou jurídico.

Parte das empresas sequer tem monitoramento em funcionamento

Mais preocupante ainda: 12% das organizações afirmam que não têm nenhum sistema de monitoramento implementado. Em outras palavras, adotaram GenAI, mas não têm mecanismos formais para verificar se os modelos estão se comportando como deveriam, se os dados estão protegidos ou se o uso segue as diretrizes internas e regulatórias.

Esse cenário pode comprometer seriamente a escalabilidade da tecnologia e expor a empresa a riscos de compliance, reputação e falhas de desempenho que afetam diretamente os usuários finais.

Monitorar IA é mais do que uma questão técnica. É uma questão de confiança e continuidade

O verdadeiro valor da GenAI só aparece quando ela é usada com segurança e responsabilidade. E isso passa, necessariamente, por uma estrutura sólida de monitoramento.

Monitorar não é só sobre identificar erros. É sobre manter a confiança do cliente, garantir que os modelos aprendam com segurança e assegurar que a tecnologia esteja a serviço dos objetivos do negócio, e não operando de forma invisível, sem controle ou critério.

Empresas que constroem essa camada de observabilidade conseguem escalar GenAI com mais velocidade e menor risco. E, mais do que isso, criam condições para que a tecnologia continue evoluindo com propósito e sustentabilidade.

Siga nossas Redes Sociais e veja mais Conteúdos como Este!