A inteligência artificial generativa tem avançado rapidamente nas empresas, mas, à medida que o uso se expande, crescem também as dúvidas sobre onde, como e com que nível de segurança ela está sendo adotada. Embora a tecnologia esteja mais acessível, os receios em torno de sua implementação seguem em alta, e, em alguns casos, freiam decisões estratégicas.

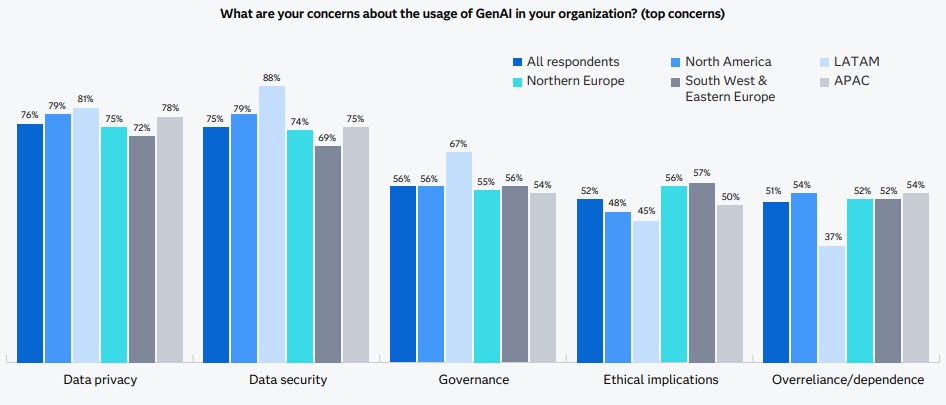

A imagem extraída do relatório da SAS traz dados valiosos sobre as maiores preocupações das organizações em relação à GenAI, com um olhar regionalizado. A análise desses dados ajuda a entender por que confiança, governança e preparação continuam sendo temas centrais no debate sobre IA no ambiente corporativo.

Privacidade e segurança lideram as preocupações de forma quase unânime

Privacidade de dados (76%) e segurança da informação (75%) aparecem no topo da lista de preocupações globais. Esses números são altos em todas as regiões, com destaque para América Latina e América do Norte. Na Europa e Ásia-Pacífico, o índice também é elevado, refletindo o receio sobre vazamento de informações confidenciais, uso indevido de dados sensíveis e exposição a ataques cibernéticos.

Essas preocupações são mais do que justificadas. Modelos de GenAI operam com grandes volumes de dados e, muitas vezes, sem explicabilidade completa. Quando utilizados em fluxos sensíveis, como jurídico, financeiro ou atendimento ao cliente, o risco reputacional e legal aumenta significativamente.

A falta de governança clara é um gargalo que limita a escala

A terceira maior preocupação entre as organizações é a governança. No total, 56% dos respondentes apontam a ausência de frameworks robustos como um desafio para a adoção estruturada da GenAI.

Aqui, o destaque vai para a América Latina, onde 67% dos respondentes colocaram governança como um dos principais desafios, o maior percentual entre todas as regiões. Isso mostra que a maturidade regulatória e a capacidade de definir diretrizes internas ainda precisam evoluir para acompanhar o ritmo de implementação da IA.

Sem governança, não há critério de uso, responsabilidade clara ou mecanismos para monitorar e corrigir desvios. A consequência é o uso improvisado e a perda de controle sobre o impacto real da tecnologia.

Preocupações éticas e dependência excessiva completam o topo do ranking

Questões éticas aparecem com 52% das menções, refletindo um incômodo sobre os limites da IA em decisões sensíveis, criação de conteúdo e viés algorítmico. A região de South West & Eastern Europe se destaca nesse ponto, indicando uma atenção maior ao impacto social da tecnologia.

Além disso, 51% das organizações temem se tornar excessivamente dependentes da GenAI, o que pode enfraquecer a autonomia dos profissionais, reduzir a supervisão humana ou comprometer a adaptabilidade em cenários fora do padrão.

Essas preocupações mostram que a confiança na IA não depende apenas da performance do modelo. Ela está ligada à forma como a tecnologia é integrada, supervisionada e utilizada com discernimento.

Superar o medo começa com preparo, comunicação e transparência

A análise regional mostra que, embora as preocupações sejam parecidas entre países, os níveis de maturidade e resposta variam. Algumas regiões estão mais avançadas na criação de políticas internas, outras ainda enfrentam desafios mais básicos como infraestrutura e qualificação técnica.

Independentemente da localização, os dados reforçam a importância de construir confiança com base em três pilares: clareza de propósito, estrutura de governança e cultura organizacional preparada para lidar com IA de forma estratégica.

Quem adota sem estrutura corre riscos. Quem adota com responsabilidade abre espaço para criar vantagem sustentável.

Siga nossas Redes Sociais e veja mais Conteúdos como Este!