À medida que a inteligência artificial generativa se consolida em ambientes corporativos, cresce a expectativa de que seu uso seja transparente, ético e orientado por diretrizes claras. No entanto, um dado importante chama atenção: a maioria esmagadora dos clientes ainda não instruiu formalmente seus prestadores de serviço sobre como, ou se, GenAI pode ser usada em seus projetos.

A pesquisa da Thomson Reuters revela uma lacuna preocupante. Mesmo com a crescente adoção da IA por escritórios jurídicos e firmas tributárias, poucos clientes estão sinalizando limites, requisitos ou políticas específicas relacionadas a essa tecnologia. A ausência de orientação explícita abre espaço para interpretações subjetivas e, em alguns casos, pode gerar riscos desnecessários.

A maioria absoluta ainda não sabe ou não estabeleceu diretrizes

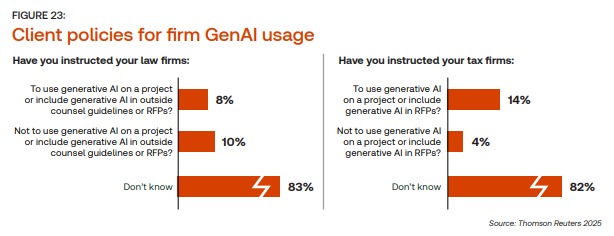

Quando perguntados se já haviam instruído seus escritórios jurídicos sobre o uso de GenAI, apenas 8% dos clientes disseram que sim. Outros 10% afirmaram que proibiram formalmente o uso. Os impressionantes 83% restantes responderam que não sabem se isso foi feito ou não.

A situação nas firmas de contabilidade é parecida. Apenas 14% disseram ter autorizado ou orientado o uso da tecnologia em projetos. Apenas 4% proibiram. Os outros 82% não têm certeza ou não se posicionaram.

Essa falta de clareza mostra que, embora o debate sobre GenAI esteja avançando, ele ainda não foi incorporado de forma estruturada nas diretrizes contratuais, nas solicitações de proposta ou nas políticas de governança de muitos clientes.

A falta de política não é isenção de responsabilidade

Se uma organização não define como espera que GenAI seja usada em serviços terceirizados, ela assume implicitamente o risco do uso não supervisionado. Isso vale para tarefas como revisão de documentos, análises técnicas ou mesmo respostas a consultas estratégicas.

Sem diretrizes claras, os fornecedores acabam decidindo por conta própria até onde podem ir com a IA. E embora muitos façam isso com responsabilidade, outros podem ultrapassar limites éticos ou operacionais sem nem perceber. O risco não está apenas no uso incorreto da ferramenta, mas na desconexão entre expectativa e prática.

Transparência começa com alinhamento desde o início do projeto

Para clientes que contratam serviços jurídicos, fiscais ou técnicos, já não basta avaliar a qualidade da entrega. É preciso entender como ela foi construída. A IA generativa pode ter sido usada para redigir, revisar, resumir ou organizar a informação, e o cliente tem o direito (e o dever) de saber disso.

Isso não significa impedir o uso da tecnologia, mas estabelecer parâmetros. Pode-se, por exemplo, autorizar o uso apenas em fases preliminares, exigir supervisão humana em todas as saídas da IA ou solicitar que o uso seja declarado em relatórios ou apresentações finais.

Essa transparência cria um ambiente mais seguro e profissional para todos os envolvidos.

As organizações que definirem diretrizes agora estarão melhor preparadas para escalar com segurança

A GenAI não vai desaparecer. Ela vai se integrar ainda mais aos fluxos de trabalho, próprios e terceirizados. Por isso, organizações que definirem desde já como querem que a IA seja usada em suas relações externas sairão na frente.

Criar políticas claras, revisar contratos e atualizar RFPs são passos essenciais para garantir consistência, segurança jurídica e alinhamento ético no uso da tecnologia.

Não se trata de controle pelo controle. É sobre garantir que a inovação respeite os limites e valores da empresa.

Siga nossas Redes Sociais e veja mais Conteúdos como Este!